Problematyka niezawodności zasilania gwarantowanego oraz systemu informatycznego w obiektach data center (część 1.)

The chosen aspects of the reliability of guaranteed power supply and information system in the data centers buildings

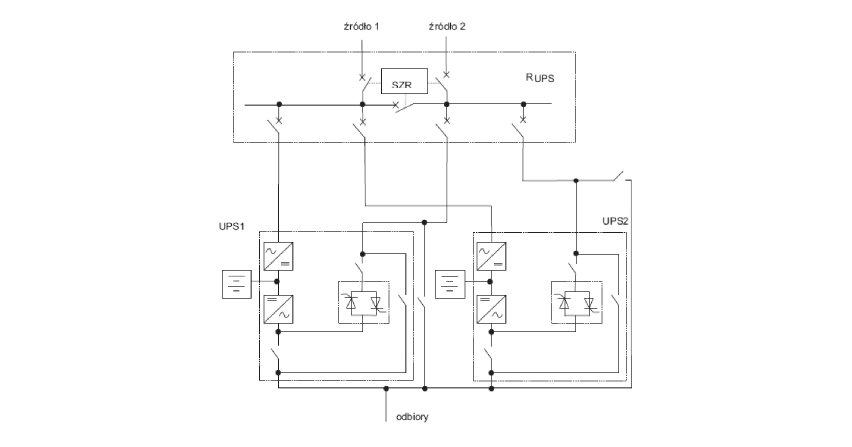

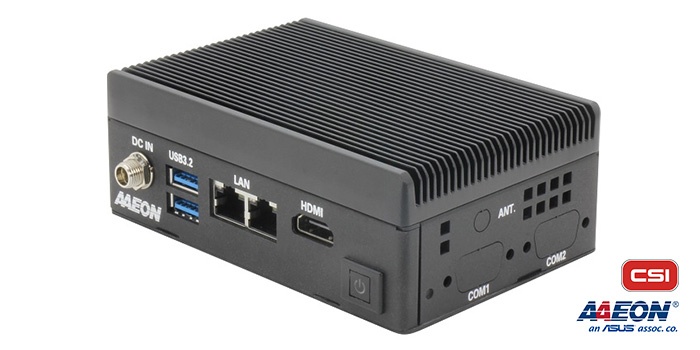

Fot. K. Kuczyński

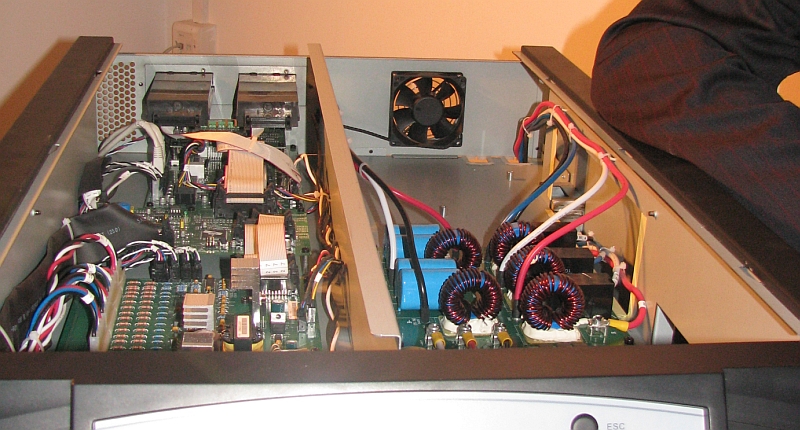

Zagadnienie niezawodności zasilania gwarantowanego w obiektach data center jest bardzo istotne na etapie zarówno budowy, jak również eksploatacji obiektu. Niezawodność systemu informatycznego w obiektach data center jest szerszym

pojęciem, związanym m.in.: z czynnikiem ludzkim, jakością sprzętu IT, jak również właściwymi parametrami środowiska serwerowni. Wysoka niezawodność nie zawsze gwarantuje wysoką dostępność systemu.

Zobacz także

dr inż. Karol Kuczyński Tandem zespół prądotwórczy i zasilacz UPS

Obiekty wymagające zwiększonej niezawodności dostarczanego zasilania to: banki, centra przetwarzania danych, szpitale, metro, obiekty telekomunikacyjne oraz kompleksy biurowe w pełni sterowane przez układy...

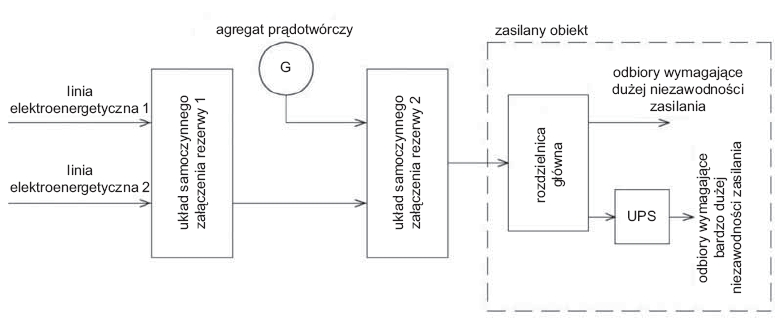

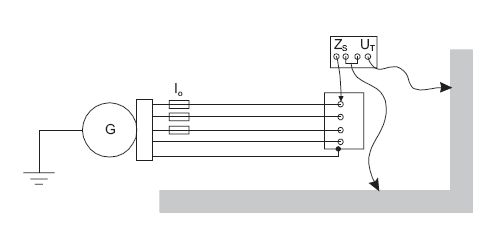

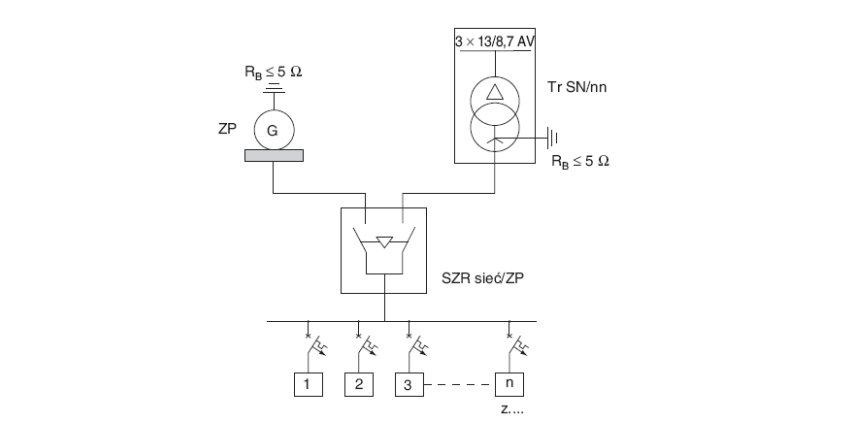

Obiekty wymagające zwiększonej niezawodności dostarczanego zasilania to: banki, centra przetwarzania danych, szpitale, metro, obiekty telekomunikacyjne oraz kompleksy biurowe w pełni sterowane przez układy inteligentnego budynku. Niejednokrotnie zastosowanie zasilania dwustronnego z sieci elektroenergetycznej jest niewystarczające i należy instalować dodatkowe źródło energii w postaci zespołu prądotwórczego.

dr inż. Karol Kuczyński Układy SZR

Układy samoczynnego załączania rezerwy (SZR) pozwalają na automatyczne załączanie odbiorników do toru rezerwowego w przypadku zaniku napięcia w torze zasilania podstawowego. Po powrocie napięcia w torze...

Układy samoczynnego załączania rezerwy (SZR) pozwalają na automatyczne załączanie odbiorników do toru rezerwowego w przypadku zaniku napięcia w torze zasilania podstawowego. Po powrocie napięcia w torze zasilania podstawowego następuje automatyczny powrót układu zasilania do stanu pierwotnego. Układy SZR są najczęściej stosowane w obiektach, w których wymagana jest ciągłość zasilania, na przykład w szpitalach, bankach czy budynkach użyteczności publicznej. Szpital jest obiektem, w którym nawet krótka...

Impakt SA Nowa rodzina zasilaczy PowerWalker UPS VFI EVS 5 kVA z magazynami energii

Seria PowerWalker VFI EVS to nowa generacja zasilaczy UPS, oferująca długi czas podtrzymania dzięki zastosowaniu baterii LiFePO4 o 40% mniejszej masie i wymiarach w odniesieniu do klasycznych baterii kwasowo-ołowiowych....

Seria PowerWalker VFI EVS to nowa generacja zasilaczy UPS, oferująca długi czas podtrzymania dzięki zastosowaniu baterii LiFePO4 o 40% mniejszej masie i wymiarach w odniesieniu do klasycznych baterii kwasowo-ołowiowych. Zastosowana topologia podwójnej konwersji (VFI-SS-311) gwarantuje najwyższy poziom bezpieczeństwa, a wyspecjalizowane układy utrzymują współczynnik mocy PF na poziomie > 0.99. Oczywiście zależy on od podłączonych urządzeń odbiorczych. Wszelkie informacje o stanie UPS widoczne są na...

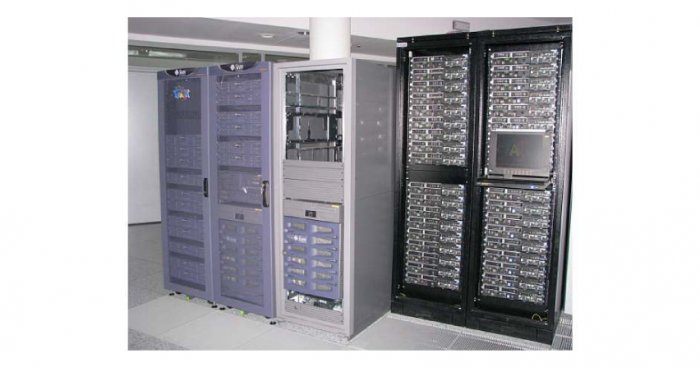

Zgodnie z normą ANSI/TIA-942, centrum danych (ang. data center) jest budynkiem lub jego częścią, która składa się z serwerowni (ang. computer room) oraz obszarów wspierających funkcjonalność całego centrum. Obiekt typu data center to ściśle wg TIA-942: budynek lub część budynku, która w swej podstawowej funkcji mieści pomieszczenie komputerowe oraz strefy podtrzymujące.

W wypadku prawdziwego centrum danych – serwerownia jest więc pomieszczeniem przeznaczonym do utrzymania pracy sprzętu serwerowego w odpowiednich warunkach – właściwe zasilanie, chłodzenie, bezpieczeństwo, łączność, obsługa itp. Parametry te są zapewniane i dostarczane przez instalacje rozlokowane w pomieszczeniach funkcjonalnych [1]. Błędem jest w tym wypadku nazwanie całości serwerownią, ponieważ jest ona jedynie jego częścią.

W wypadku jednego pomieszczenia, które pełni wszystkie wspomniane funkcje, możemy użyć zarówno określenia centrum danych, jak i serwerownia.

W takiej sytuacji serwerownia jest pomieszczeniem przeznaczonym do utrzymania pracy sprzętu serwerowego w odpowiednich warunkach, które są zapewniane i dostarczane przez instalacje umieszczone głównie w tym pomieszczeniu.

Takie urządzenia jak jednostki zewnętrzne klimatyzacji czy zespół prądotwórczy zawsze będą zainstalowane poza serwerownią, jednak wszelkie instalacje wewnętrzne są scentralizowane i zamknięte w jednym, odpowiednio chronionym miejscu. W Polsce dodatkowo bywa stosowane określenie „centrum przetwarzania danych”, w skrócie CPD. Termin CPD nie oddaje jednak właściwego znaczenia tego miejsca. Zgodnie ze standardem ANSI/TIA-942 wyróżniamy tylko definicje „data center” oraz „computer room”, które wyczerpują problem nazewnictwa oraz pozwalają na rozróżnienie funkcjonalności.

Do podstawowych elementów infrastruktury data center zaliczamy:

- szafy teleinformatyczne,

- okablowanie,

- dystrybucję zasilania,

- klimatyzację i wentylację,

- system przeciwpożarowy,

- kontrolę dostępu,

- monitoring środowiskowy.

Łączna powierzchnia wszystkich komercyjnych data center w Polsce wynosi, według stanu na pierwszą połowę 2013 r., prawie 60 tys. m2, co w przybliżeniu odpowiada potencjałowi jednego data center wybudowanego przez Microsoft w 2008 r. w Northlake (okolice Chicago, USA) [3].

Rynek data center w Polsce jest nadal w dużym stopniu rozproszony, wykazuje też duży rozrzut w skali i zakresie świadczonych usług. Obok dużych i profesjonalnych data center istnieje duża grupa mniejszych dostawców, nastawionych przeważnie na obsługę klientów o mniejszej skali działalności i mniejszych wymaganiach co do jakości usługi [3].

Małe data center zajmuje typowo około 300–1000 m2 powierzchni oraz ma zapotrzebowanie na moc około 500–2000 kVA.

Średniej wielkości data center zajmuje powierzchnię około 2000–3000 m2 przy zapotrzebowaniu na moc około 4000–7000 kVA [11].

Rynek usług data center w Polsce charakteryzuje się znacznym rozdrobnieniem. Udziały rynkowe liderów sięgają kilkunastu procent i żadnemu z nich nie udało się jak dotąd zdobyć trwałej przewagi konkurencyjnej.

Powierzchnia większości polskich obiektów data center nie przekracza 1000 m2, a największymi powierzchniami kolokacyjnymi w pojedynczych lokalizacjach (powyżej 3000 m2) dysponują: TP (Łódź), GTS Poland (Piaseczno), Network Communications (Łódź) oraz Onet (Kraków) [3].

Normy – budowa obiektu typu data center

W złożonym procesie projektowania, budowy i eksploatacji obiektu typu data center należy stosować się do odpowiednich norm i rozporządzeń.

W zakresie instalacji elektroenergetycznych wyróżniamy [2]:

- normy dotyczące instalacji elektrycznych w obiektach budowlanych:

- PN-IEC 60364 Instalacje elektryczne w obiektach budowlanych, - normy dotyczące dystrybucji energii:

- PN-EN 50600-2-2:2014-06 Technika informatyczna. Wyposażenie i infrastruktura centrów przetwarzania danych. Część 2-2: Dystrybucja energii, - normy dotyczące ochrony odgromowej obiektów budowlanych:

- PN-EN 62305-1:2011 Ochrona odgromowa. Część 1: Wymagania ogólne,

- PN-EN 62305-2:2012 Ochrona odgromowa. Część 2: Zarządzanie ryzykiem,

- PN-EN 62305-3:2011 Ochrona odgromowa. Część 3: Uszkodzenia fizyczne obiektów budowlanych i zagrożenie życia,

- PN-EN 62305-4:2011 Ochrona odgromowa. Część 4: Urządzenia elektryczne i elektroniczne w obiektach budowlanych, - normy dotyczące instalacji oświetleniowej wnętrz:

- PN-EN 12464-1:2012 Światło i oświetlenie. Oświetlenie miejsc pracy. Część 1: Miejsca pracy we wnętrzach, - normy dotyczące zespołów prądotwórczych:

- PN-EN 12601:2011 Zespoły prądotwórcze napędzane silnikami spalinowymi tłokowymi. Bezpieczeństwo (oryg.),

- PN-ISO 8528-1:1996 Zespoły prądotwórcze prądu przemiennego napędzane silnikiem spalinowym tłokowym. Zastosowanie, klasyfikacja i wymagania eksploatacyjne (norma wycofana),

- PN-EN 60034-22:2010 Zespoły prądotwórcze prądu przemiennego napędzane silnikiem spalinowym tłokowym. Prądnice prądu przemiennego do zespołów prądotwórczych,

- PN-EN 60034-1:2011 Maszyny elektryczne wirujące. Część 1: Dane znamionowe i parametry,

- PN-EN 60034-2-1:2015-01 Maszyny elektryczne wirujące. Metody wyznaczania strat i sprawności na podstawie badań (z wyjątkiem maszyn pojazdów trakcyjnych),

- PN-EN 60034-8:2007 Maszyny elektryczne wirujące. Część 8: Oznaczanie wyprowadzeń i kierunek wirowania maszyn wirujących,

- PN-EN 60034-14:2004/A1:2007 Maszyny elektryczne wirujące. Część 14: Drgania mechaniczne określonych maszyn o wznosach osi wału 56 mm i większych. Pomiar, ocena i wartości graniczne intensywności drgań,

- PN-EN 60034-22:2010 Maszyny elektryczne wirujące. Prądnice prądu przemiennego do zespołów prądotwórczych napędzanych tłokowymi silnikami spalinowymi,

- PN-93/T-0645 Przemysłowe zakłócenia radioelektryczne. Urządzenia i metody pomiarów zakłóceń radioelektrycznych,

- PN-E-06704:1994 Maszyny elektryczne wirujące. Metody wyznaczania wielkości charakterystycznych maszyn synchronicznych na podstawie badań,

- PN-87/B-02156 Akustyka budowlana. Metody pomiaru dźwięku A w budynkach,

- PN-87/B-02151.02 Akustyka budowlana. Ochrona przed hałasem pomieszczeń w budynkach – Dopuszczalne wartości poziomu dźwięku w pomieszczeniach, - normy dotyczące zasilaczy UPS:

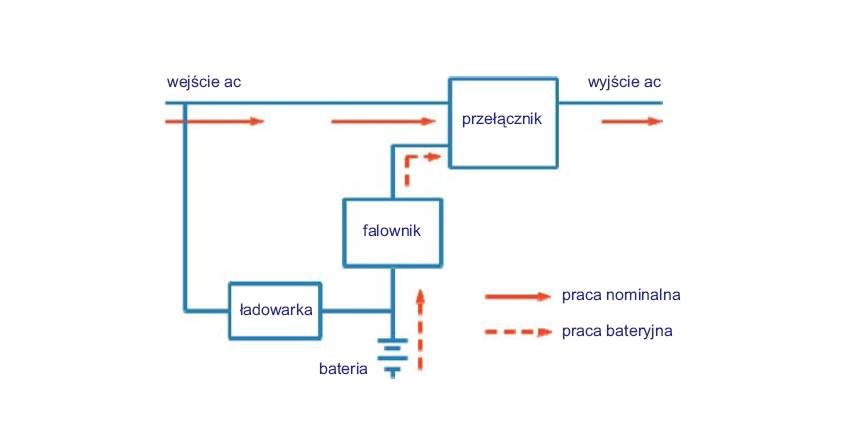

- PN-EN 62040-1:2009/A1:2013-10 Systemy bezprzerwowego zasilania (UPS). Część 1: Wymagania ogólne i wymagania dotyczące bezpieczeństwa UPS,

- PN-EN 62040-3:2005/A11:2009 Systemy bezprzerwowego zasilania (UPS). Część 3: Metody określania właściwości i wymagania dotyczące badań,

- PN-EN 62040-2:2008 Systemy bezprzerwowego zasilania (UPS). Część 2: Wymagania dotyczące kompatybilności elektromagnetycznej (EMC),

- PN-EN ISO 9001:2009 Systemy zarządzania jakością. Wymagania,

- PN-EN ISO 14001:2005 Systemy zarządzania środowiskowego. Wymagania i wytyczne stosowania, - normy w zakresie specyfikacji wymagań niezawodnościowych oraz analizy niezawodności:

- PE-EN 60300-3-1:2005 Zarządzanie niezawodnością. Część 3-1: Przewodnik zastosowań. Techniki analizy niezawodności. Przewodnik metodologiczny,

- PN-EN 61078:2006 Techniki analizy niezawodności. Metoda schematów blokowych niezawodności oraz metody boolowskie,

- PN-EN 60300-3-4:2008 Zarządzanie niezawodnością. Część 3-4: Przewodnik zastosowań. Przewodnik dotyczący specyfikowania wymagań niezawodnościowych.

W złożonym procesie budowy obiektu typu data center oprócz wymienionej wcześniej grupy norm dotyczących szeroko pojętych instalacji elektroenergetycznych mają również zastosowanie inne normy, ustawy i rozporządzenia z następujących zakresów tematycznych [2]:

- ustawy i rozporządzenia w zakresie budowy obiektu z przeznaczeniem na ośrodek obliczeniowy,

- normy dotyczące instalacji teleinformatycznych,

- normy dedykowane (technika informatyczna) dla obiektów data center,

- normy związane z zabezpieczeniem przed zakłóceniami elektromagnetycznymi i radiowymi,

- normy związane z zabezpieczeniem przed zalaniem wodą oraz kurzem, gazem lub dymem,

- normy związane z zabezpieczeniem przed włamaniem oraz z Elektronicznym Systemem Ochrony (ESO),

- normy związane z zabezpieczeniem przed pożarem.

Warto zwrócić uwagę na fakt, że obecnie w CENELEC powstaje grupa europejskich norm kompleksowo ujmujących zagadnienia data center o symbolu EN 50600. Opublikowana norma EN 50600-1 obejmuje pojęcia ogólne [6].

Sześć arkuszy z grupy EN 50600-2-x obejmuje zagadnienia związane z poszczególnymi elementami infrastruktury fizycznej (do chwili obecnej zatwierdzono i opublikowano arkusze norm 2-1, 2-2, 2-3 oraz 2-4).

Struktura grupy norm jest następująca:

- EN 50600-1 Information technology. Data Centre facilities and infrastructure. Part 1: General concepts,

- EN 50600-2-1 Information technology. Data Centre facilities and infrastructure. Part 2-1: Building construction,

- EN 50600-2-2 Information technology. Data Centre facilities and infrastructure. Part 2-2: Power distribution,

- EN 50600-2-3 Information technology. Data Centre facilities and infrastructure. Part 3-2: Environmental control,

- EN 50600-2-4 Information technology. Data Centre facilities and infrastructure. Part 2-4: Telecommunications cabling infrastructure,

- EN 50600-2-5 Information technology. Data Centre facilities and infrastructure. Part 2-5: Security systems,

- EN 50600-2-6 Information technology. Data Centre facilities and infrastructure. Part 2-6: Management and operational information.

Szczególną uwagę należy zwrócić w kontekście niezawodności zasilania na normę EN 50600-2-2 dotyczącą dystrybucji zasilania.

Jednym z elementów kończących budowę obiektu są testy odbiorcze związane z zasilaniem elektrycznym. Testy dotyczą m.in.: uziemienia całości systemu, okablowania, szynoprzewodów, rozdzielnic elektrycznych, zespołów prądotwórczych, zasilaczy UPS, urządzeń ATS, STS, systemów SZR, systemów awaryjnego wyłączenia zasilania (EPO) oraz współdziałania systemów.

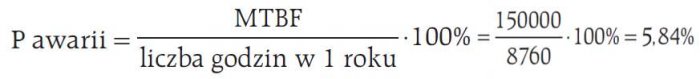

Miary niezawodności i dostępności

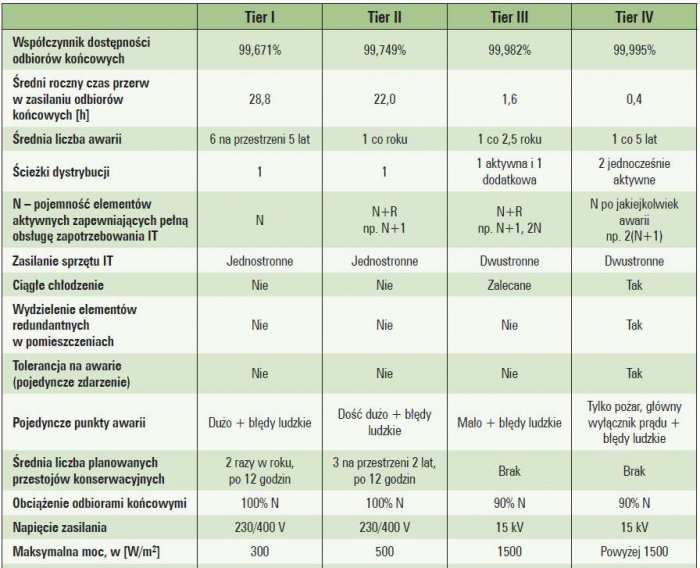

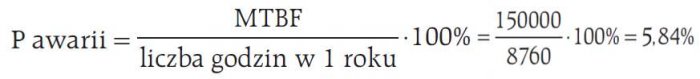

Klasyfikacja Tier dzieli obiekty data center na 4 poziomy. Dany poziom Tier związany jest ściśle z wartością dostępności.

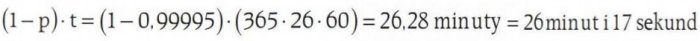

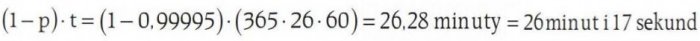

Przykładowo, w przypadku najwyższego poziomu Tier IV dostępność musi być równa co najmniej 99,995%. Łatwo z tej wartości obliczyć szacowany czas niedostępności w okresie roku:

gdzie:

p – czas dostępności,

t – liczba okresów czasu w ciągu roku (np. minut).

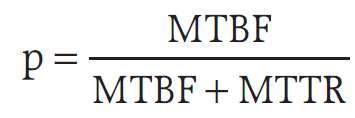

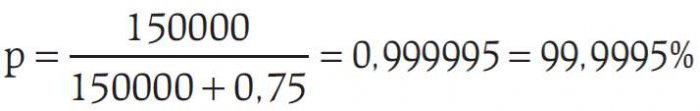

Dostępność systemu/urządzenia obliczana jest następująco:

gdzie:

- MTBF – (ang. Mean Time Between Failure) – średni czas pracy urządzenia pomiędzy awariami deklarowany przez producenta (np. w przypadku wysokiej klasy trójfazowego zasilacza UPS średniej mocy czas ten wynosi około 150 000 godzin). Przy jego stosowaniu trzeba pamiętać, iż nie oznacza on szacowanego okresu eksploatacji urządzenia (szczegóły w dalszej części tekstu),

- MTTR (ang. Mean Time to Repair) – średni czas naprawy urządzenia (czas ten w praktyce stanowi suma czasu od momentu awarii do momentu rozpoczęcia naprawy oraz samego czasu naprawy – producenci typowo podają tylko czas średni samej naprawy urządzenia, warto o tym pamiętać). W przypadku rozważanego UPS czas naprawy wynosi typowo od 30 do 60 minut. Zastosowanie UPS o budowie modułowej może skrócić czas naprawy.

Dostępność systemu zasilania w przypadku rozważanego zasilacza UPS wyniesie więc teoretycznie, przyjmując czas naprawy MTTR = 0,75 h:

Otrzymany wynik (99,9995%) wskazuje na pewną wadę (ułomność) parametru MTBF podawanego przez producentów.

Otóż wartość MTBF = 150 000 godzin to przecież ponad 17 lat ciągłej pracy do awarii. Zauważmy, że nikt przecież nie testuje grupy UPS-ów przez 17 lat i nie mierzy czasów pracy do awarii zasilacza UPS.

MTBF wynika obecnie z pewnych statystyk związanych ze spodziewanymi czasami życia poszczególnych elementów konstrukcji UPS i należy do takiej miary podchodzić z dużą rezerwą.

Dostępność systemu obliczona z wykorzystaniem wzoru (3), to wartość nienaturalnie duża. Gdyby niezawodność UPS była faktycznie tak duża, to można by zrezygnować z wyrafinowanych układów redundancji w systemach zasilania gwarantowanego. Natomiast jeśli uwzględnimy w czasie MTTR dodatkowo czas od momentu awarii do rozpoczęcia naprawy, np. równy 6 godzin, wtedy otrzymamy dostępność poziomu niezawodności Tier IV, czyli również zbyt dużą i mało realną wartość:

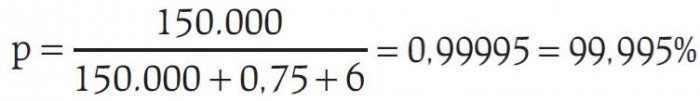

Znając wartość MTBF podaną przez producenta, łatwo obliczyć, jakie jest prawdopodobieństwo awarii w okresie 1 roku działania urządzenia, np. rozważanego zasilacza UPS [15]:

Do otrzymanej wartości 5,84% również należy zachować spory dystans. W rzeczywistości prawdopodobieństwo awarii jest raczej dużo większe.

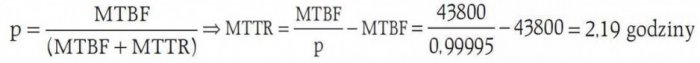

Dla poziomu niezawodności Tier IV przyjmuje się, że awaria zdarza się raz na 5 lat. Oznacza to, że taki system ma wartość MTBF = 365 dni · 24 godziny · 5 lat = 43 800 godzin, czyli wartość znacznie mniejszą niż deklarowana przez producentów UPS wartość MTBF równa 150 000 godzin. Korzystając ze wzoru (2), możemy ponadto oszacować maksymalny czas MTTR, czyli czas naprawy wraz z czasem dojazdem serwisu, aby zachowany był poziom niezawodności Tier IV (dostępność = 99,995%, 1 awaria raz na 5 lat) (wzór 6):

W branży IT (i nie tylko) zdarza się, że producenci podają współczynnik MTBF o ogromnej wartości nawet miliona godzin, z czego wynikałoby, iż takie urządzenie będzie działać bezawaryjnie przez 100 lat [12]. Taka wartość w przypadku skomplikowanych systemów jest właściwie niemożliwa do osiągnięcia, gdyż wraz z upływem czasu i technicznym zużyciem, prawdopodobieństwo awarii sprzętu rośnie

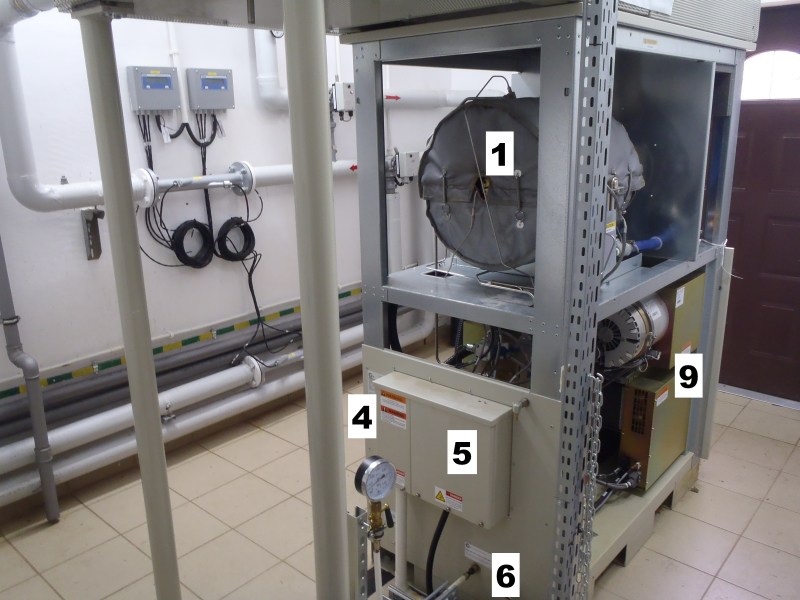

Klasyfikacja obiektów data center według poziomu niezawodności

Klasyfikacja Tier dzieli obiekty data center na 4 poziomy (Tier I, Tier II, Tier III oraz Tier IV) zgodnie z poziomem niezawodności systemu (czas MTBF) i dostępności do systemu informatycznego (wartość p) na podstawie standardu ANSI/TIA-942 oraz wytycznych Uptime Institute (UI) [14].

Warto zwrócić uwagę na fakt, że Uptime Institute jest niezależną firmą konsultingową specjalizującą się w tematyce obiektów data center o wysokiej dostępności i tworzy standardy przede wszystkim opisowe, analizujące rozwiązania stosowane w nich pod kątem potrzeb biznesowych. Są to opracowania raczej o charakterze strategii postępowania niż opisujące konkretne rozwiązania techniczne [6]. Podstawowy dokument odnoszący się do rozważanej tematyki to Data Center Infrastructure Tier Standard: Topology.

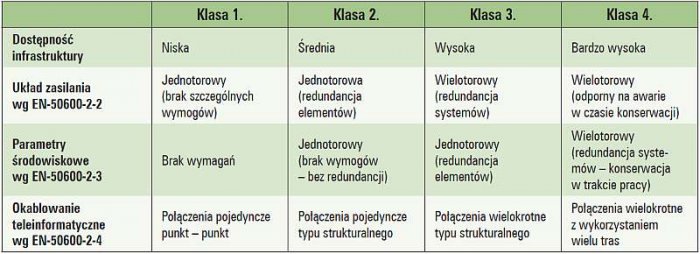

System klasyfikacji obiektów data center wg normy EN 50600-1 opiera się na ocenie kilku elementów: klasy dostępności (4 klasy), klasy zabezpieczenia (3 klasy) oraz efektywności energetycznej (3 poziomy) [6]. W tabeli 1. przedstawiono klasy dostępności w odniesieniu do obiektów data center i przykładowe implementacje zgodnie z grupą norm EN 50600. Natomiast klasyfikacja Tier wg Uptime Institute wyróżnia 4 poziomy niezawodności zasilania data center [8]:

- poziom Tier I – jeden obwód do dystrybucji zasilania i chłodzenia, brak elementów redundantnych,

- poziom Tier II – jeden obwód do dystrybucji zasilania i chłodzenia, elementy redundantne,

- poziom Tier III – zwielokrotnione obwody dystrybucji zasilania i chłodzenia, elementy redundantne, ale tylko jeden obwód aktywny,

- poziom Tier III – zwielokrotnione aktywne obwody dystrybucji zasilania i chłodzenia, elementy redundantne, odporne na błędy.

W tabeli 2 (tab. 2a i tab. 2b.) przedstawiono zestawienie głównych wymagań dotyczących klasyfikacji Tier wg Uptime Institute.

Tab. 1. Klasy dostępności data center i przykładowe implementacje zgodnie z grupą norm EN 50600 (opracowano na podstawie [2, 6])

Tab. 2. Zestawienie głównych wymagań dotyczących klasyfikacji Tier wg Uptime Institute Data Center Infrastructure Tier Standard: Topology (opracowano na podstawie [2, 5, 7, 8])

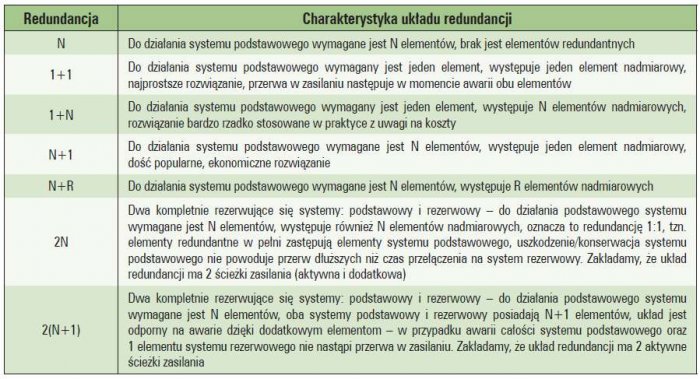

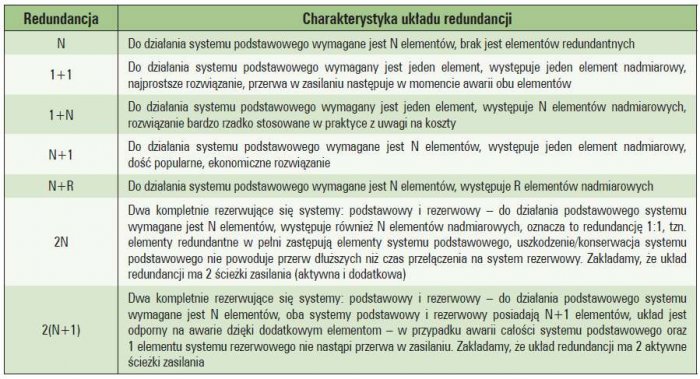

Dostępność i stopień niezawodności systemu zasilania gwarantowanego zależą ściśle od zastosowanego układu redundancji. Interpretacja poszczególnych oznaczeń stopnia redundancji elementów aktywnych została podana w tabeli 3.

Należy zwrócić uwagę, że sam układ redundancji, np. 2N nie oznacza jeszcze, że system jest jednocześnie serwisowalny, a układ 2(N+1), że układ jest odporny na awarie. To, czy system z takim układem redundancji będzie spełniał te cechy, zależy od konstrukcji układu zasilania, np. muszą istnieć 2 ścieżki dystrybucji zasilania.

Jedna aktywna i jedna dodatkowa ścieżka dystrybucji zasilania w przypadku wymagań poziomu Tier III oraz dwie aktywne ścieżki zasilania w przypadku wymagań poziomu Tier IV.

Ponadto sprzęt komputerowy musi mieć dwustronne zasilanie.

Tak więc samo stwierdzenie, że dany system ma układ redundancji 2N, nie świadczy jeszcze o konkretnym poziomie Tier takiego systemu zasilania.

Wg Uptime Institute w przypadku niektórych systemów możliwe jest osiągnięcie poziomu Tier IV nawet w układzie N+1. Ponadto warto zwrócić uwagę na to, że standard Tier nie wymaga podniesionej podłogi ani zimnego/ciepłego korytarza, ale oczywiście wybór rozwiązań ma wpływ na skuteczność chłodzenia [2].

Podobnie wybór sposobu chłodzenia (pod podłogą czy górą) zależy tylko od preferencji użytkownika. Standard Tier nie zawiera również specjalnych wymagań dotyczących systemów bezpieczeństwa. Ich wybór i zakres zależą od wymagań użytkownika oraz praktyki i polityki bezpieczeństwa [2].

Standard Tier nie zawiera także wymagań odnośnie do liczby źródeł zasilania z sieci elektroenergetycznej. Innymi słowy, teoretycznie stosowanie np. 2 źródeł zasilania z sieci nie jest obowiązkowe [2].

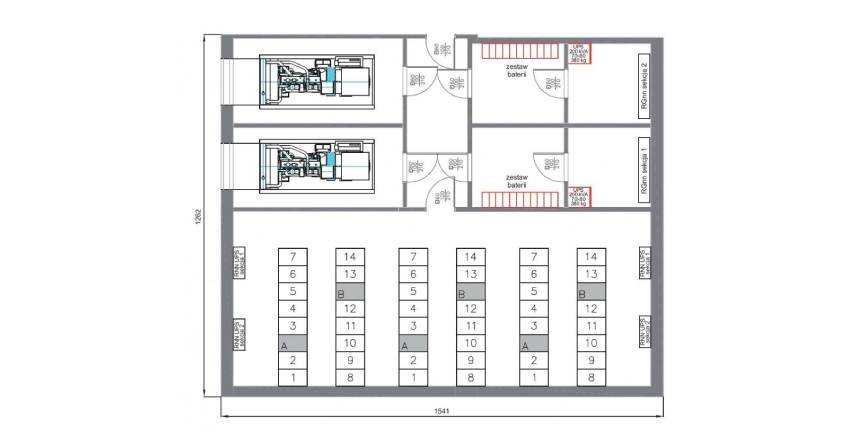

Istotne w przypadku poziomu Tier IV jest wydzielenie elementów redundancji w pomieszczeniach. W przypadku układu redundancji N+R w jednym pomieszczeniu nie powinno być więcej niż R elementów.

Przykładowo w układzie N+R dla N=3, R=2 w pojedynczym pomieszczeniu powinny znajdować się nie więcej niż 2 elementy. Ma to na celu zmniejszenie ryzyka awarii obejmującej np. wszystkie elementy będące razem w tym samym pomieszczeniu, np. pożar, zalanie lub inne zdarzenia losowe.

Ścieżki dystrybucji w przypadku poziomu Tier IV powinny mieć różne fizycznie położenia na drodze do pomieszczeń z systemem. Tier IV wymaga również w pełni autonomicznej reakcji na awarię.

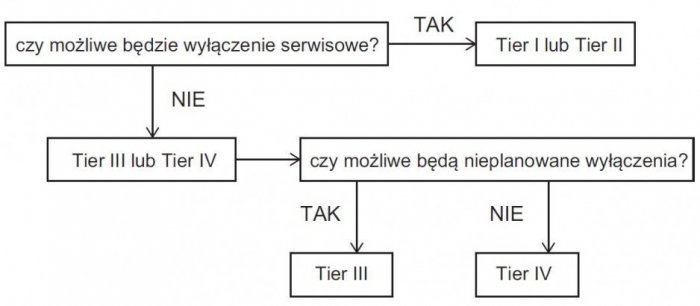

Wybór poziomu Tier zależy od oczekiwanej dostępności i niezawodności data center oraz spodziewanego poziomu kosztów związanych z brakiem działania systemu. Ilustruje to rysunek 1.

Powstaje zatem pytanie, dla jakich rodzajów firm i działalności są kolejne kategorie Tier.

W uproszczeniu podział jest następujący [4, 9]:

- Tier I – małe firmy, w których technologia informatyczna jest wykorzystywana głównie w wewnętrznej działalności i które nie odczuwają finansowo skutków awarii data center (zyski nie zależą w dużym stopniu od często występujących awarii zasilania),

- Tier II

a) przedsiębiorstwa, w których proces technologiczny ogranicza się do tradycyjnych godzin pracy, po których system może zostać wyłączony (nie potrzebują dostępu on-line po ich zakończeniu),

b) małe firmy opierające się np. na działalności internetowej, które nie ponoszą poważnych kar finansowych z tytułu jakości usług,

c) podmioty gospodarcze niemające zobowiązań dotyczących dostarczania usług w czasie rzeczywistym (np. są chronione przed brakiem dostępności systemu na podstawie umów), - Tier III – najczęściej duże firmy, których praca wymaga dostępu do zasobów znajdujących się w obiektach data center przez 24 godziny, 7 dni w tygodniu, dopuszczalne są krótkie okresy braku tego dostępu w przypadku zakłóceń spowodowanych przez zdarzenia nieplanowane. Ta kategoria polecana jest również dla firm prowadzących swoją działalność w internecie, dla których brak odpowiedniej jakości usług wiąże się z poważnymi konsekwencjami finansowymi. W wyniku rozwoju firmy i konieczności zapewniania odpowiednich standardów nastąpić może rozbudowa i migracja z kategorii III do kategorii IV,

- Tier IV – najczęściej duże i bardzo duże firmy wymagające bardzo wysokiego poziomu dostępności (np. dla firm działających 24 godziny na dobę przez wszystkie dni w roku w sektorze dużej konkurencji, w których dostęp klientów i pracowników do aplikacji decyduje o konkurencyjności). Bardzo wysokie koszty nawet krótkich przerw w zasilaniu zmuszają do zastosowania wyrafinowanych i drogich rozwiązań w zakresie zapewniania bardzo wysokiej dostępności systemu.

Do firm wymagających bardzo wysokiej niezawodności zasilania (Tier IV oraz Tier III) zaliczyć można: banki, giełdę papierów wartościowych, instytucje finansowe, transport (kolej, lotnictwo), firmy hostingowe i kolokacyjne, wojsko, policję, straż graniczną oraz szpitale.

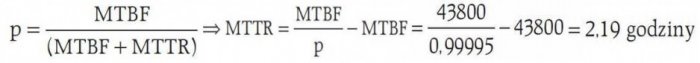

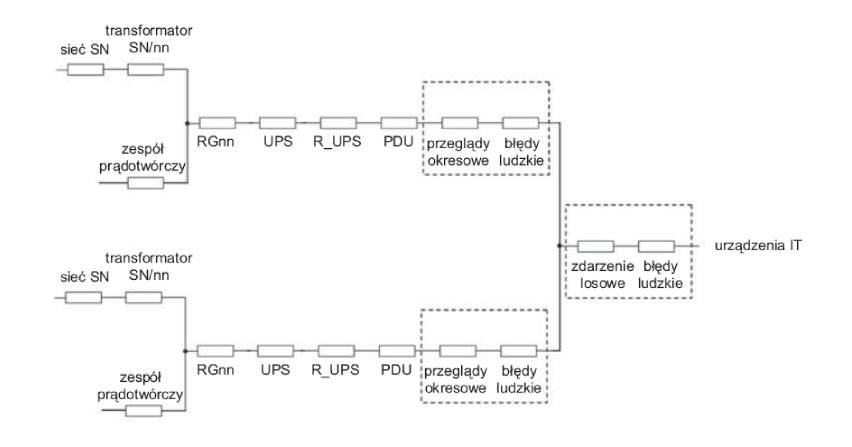

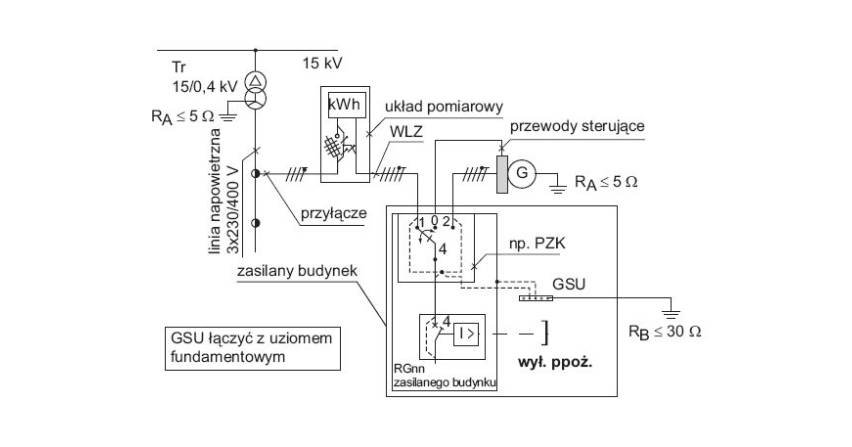

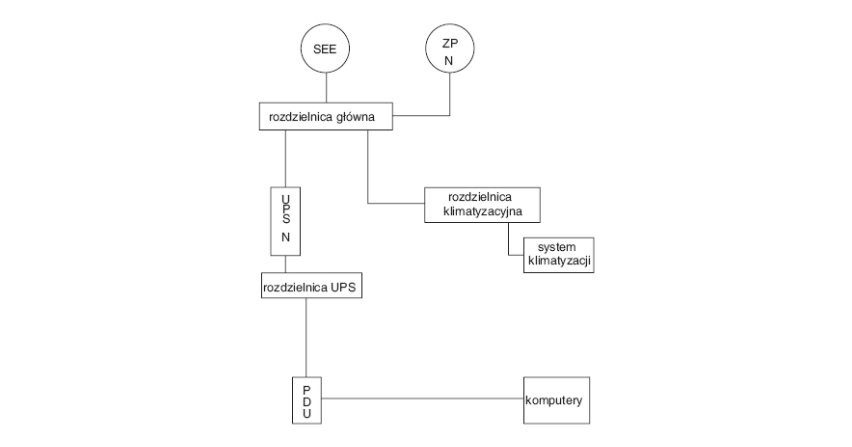

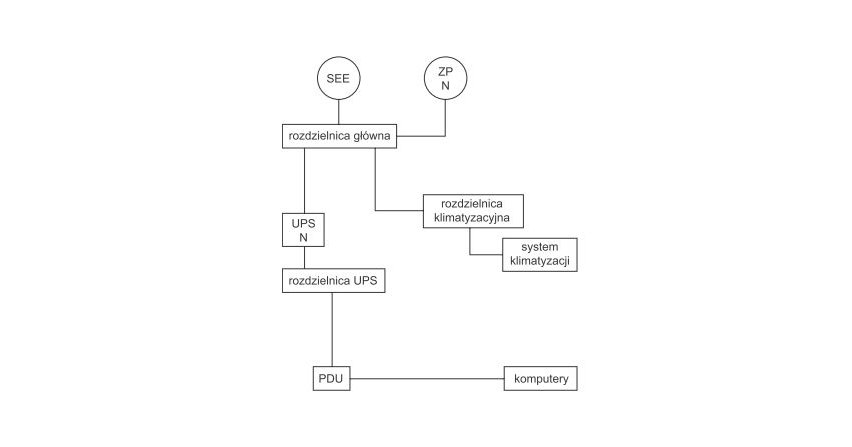

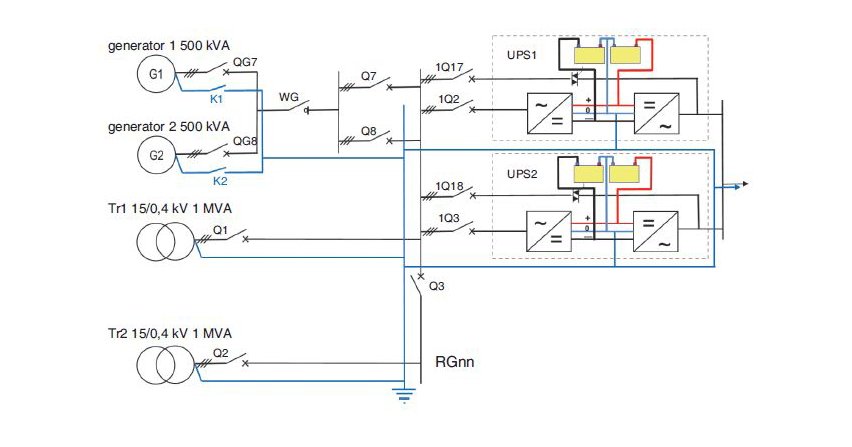

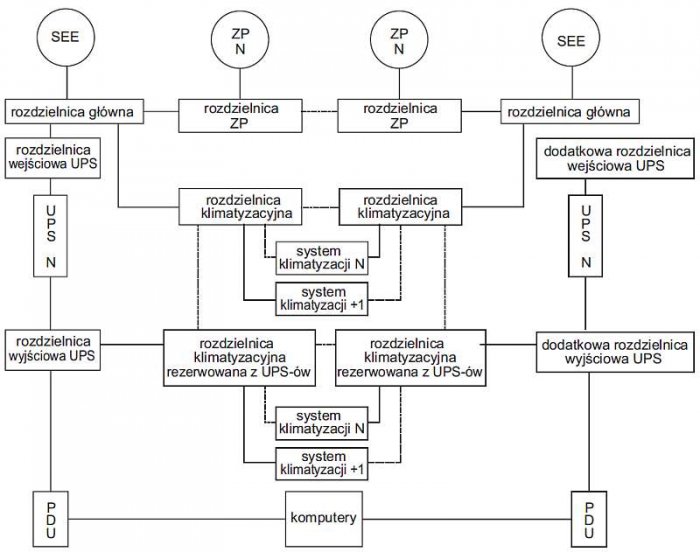

Na rysunku 2. przedstawiono przykładową topologię systemu zasilania gwarantowanego zgodnego z kategorią Tier IV [9]. Topologia poziomu IV jest najdroższą i jednocześnie najbardziej niezawodną ze wszystkich topologii przedstawionych w klasyfikacji Uptime Institute.

Na rysunku 2. przedstawiony został układ redundancji „2N”, ale możliwy jest także układ „2(N+1)” różniący się komponentami nadmiarowymi, których brakuje w układzie „2N”.

Rys. 2. Przykładowa topologia systemu zasilania gwarantowanego klasy Tier IV (opracowano na podstawie [10])

Dwa niezależne od siebie źródła zasilania odbiorów powodują, że system nie ma wspólnych punktów decydujących o dostępności systemu.

Cały sprzęt IT zgodnie z ustaleniami dla kategorii Tier IV powinien mieć dwustronne zasilanie, aby zapewnić możliwość konserwacji systemu zasilania pomiędzy sprzętem IT a urządzeniem UPS bez przerwy w pracy systemu komputerowego.

Każdy element systemu klimatyzacji i systemu zasilania może zostać usunięty na czas planowanego serwisu bez konieczności wyłączania systemu komputerowego. Istotne jest również, że systemy uzupełniające się i linie zasilające muszą być całkowicie oddzielone w celu zapewnienia odpowiedniej niezawodności systemu. System jest odporny na awarię, ale należy pamiętać, że uruchomienie się alarmu przeciwpożarowego (pożar) lub awaryjne wyłączenie zasilania spowodują przerwę w działaniu systemu.

Literatura

- N. Szkwir, Jaka jest różnica pomiędzy serwerownią a centrum danych?, 5.05.2011, http://www.networkmagazyn.pl.

- Poradnik projektanta, BKT Elektronik.

- E. Konarzewski, G. Bernatek, Data center w Polsce, 23.10.2013, http://www.computerworld.pl.

- M. Piechulek, Serwerownie, data center, Centra przetwarzania danych, prezentacja firmy BKT Elektronik, 3.07.2013.

- http://uptimeinstitute.com.

- K. Szczygieł, Tworzenie koncepcji infrastruktury fizycznej Data Center w oparciu o normy, 8th PLNOG Meeting, 5–6 marca 2012.

- P. Piotrowski, M. Derlacki, Klasyfikacja niezawodności dla obiektów typu data center, „elektro.info” nr 6/2014.

- J. Wiatr, M. Orzechowski, M. Miegoń, A. Przasnyski, Poradnik projektanta systemów zasilania awaryjnego i gwarantowanego (wydanie II poprawione i rozszerzone), tom I, Eaton Quality Power, 2008.

- P. Piotrowski, Niezawodność zasilania gwarantowanego dla obiektów typu data center, „Elektro.info” nr 10/2014.

- Uptime Institute, White Paper, Tier Classifications Define Site Infrastructure Performance, by W. Pitt Turner IV, John H. Seader, PE, Vince Renaud, PE, and Kenneth G. Brill, 2008.

- E. Konarzewski, Najnowsze trendy na rynku data center w Polsce, prezentacja, Audytel, 2013.

- S. Igras, Dostępność i niezawodność, 12.01.2015, http://www.computerworld.pl.

- P. Piotrowski, R. Pająk, Analiza układów zasilania dla obiektu typu data center w zależności od wymaganego poziomu niezawodności, część 1 – porównanie kosztów budowy poszczególnych układów zasilania, „elektro.info” nr 12/2012.

- Piotrowski, R. Pająk, Analiza układów zasilania dla obiektu typu data center w zależności od wymaganego poziomu niezawodności, część 2 – porównanie niezawodności układów zasilania w standardach Tier, „elektro.info” nr 1–2/2013.

- P. Piotrowski, Aspekty elektryczne sieci komputerowych, wydanie II rozszerzone, Oficyna Wydawnicza Politechniki Warszawskiej, Warszawa 2011.

![Tab. 1. Klasy dostępności data center i przykładowe implementacje zgodnie z grupą norm EN 50600 (opracowano na podstawie [2, 6])](https://www.elektro.info.pl/media/cache/typical_view/data/201905/problematyka-niezawodnosci-data-center-tab1.jpg)

![Tab. 2. Zestawienie głównych wymagań dotyczących klasyfikacji Tier wg Uptime Institute Data Center Infrastructure Tier Standard: Topology (opracowano na podstawie [2, 5, 7, 8])](https://www.elektro.info.pl/media/cache/typical_view/data/201905/problematyka-niezawodnosci-data-center-tab2.jpg)

![Tab. 2a. Zestawienie głównych wymagań dotyczących klasyfikacji Tier wg Uptime Institute Data Center Infrastructure Tier Standard: Topology (opracowano na podstawie [2, 5, 7, 8]) - ciąg dalszy](https://www.elektro.info.pl/media/cache/typical_view/data/201905/problematyka-niezawodnosci-data-center-tab2a.jpg)

![Rys. 1. Schemat wyboru poziomu Tier (opracowano na podstawie [2])](https://www.elektro.info.pl/media/cache/typical_view/data/201905/problematyka-niezawodnosci-data-center-rys1.jpg)

![Rys. 2. Przykładowa topologia systemu zasilania gwarantowanego klasy Tier IV (opracowano na podstawie [10])](https://www.elektro.info.pl/media/cache/typical_view/data/201905/problematyka-niezawodnosci-data-center-rys2.jpg)